はじめに

ChatGPTをはじめとする生成AIの業務利用が急速に広がる中、多くの企業でそのルール作りが急務となっています。利便性の裏に潜む情報漏洩や著作権侵害などのリスクを適切に管理し、従業員が安心してその能力を最大限に引き出すためには、明確な社内規定の策定が不可欠です。

本記事では、生成AIの社内規定を作成するための具体的なステップ、盛り込むべき必須項目、そして参考にすべき企業の事例まで、網羅的に解説します。

生成AIの社内規定(ガイドライン)がなぜ今必要なのか?

近年、生成AIは文章作成、アイデア出し、議事録要約など、様々な業務を効率化するツールとして注目を集めています。しかし、その手軽さとは裏腹に、企業活動に重大な影響を及ぼしかねないリスクも存在します。明確なルールがないままでは、従業員はどの業務に、どこまで利用して良いのか判断できず、結果としてリスクの高い利用や、逆に有益な活用の機会損失につながる可能性があります。

| 項目 | 規定がない場合の問題点 | 規定がある場合のメリット |

| セキュリティ | 情報漏洩のリスクが増大し、 会社の信用が失墜する可能性がある。 |

禁止事項が明確になり、 機密情報の漏洩を未然に防げる。 |

| コンプライアンス | 意図せず著作権を侵害し、 法的な紛争に発展する可能性がある。 |

権利侵害のリスクを従業員が認識し、 適切な利用が可能になる。 |

| 生産性 | 利用可否の判断ができず、AI活用の機会を逃す。 または利用が混乱する。 |

利用範囲が明確になり、 全社的に安全で均一な活用が促進される。 |

| 従業員の意識 | リスクへの意識が低く、 無防備な利用が横行する。 |

研修などを通じてリテラシーが向上し、 責任ある利用が根付く。 |

業務利用の急速な拡大に伴う新たなリスクの出現

生成AIの利用者が増えるにつれて、これまで想定されていなかったリスクが顕在化しています。例えば、従業員が顧客情報や社外秘の情報を入力してしまい、それがAIの学習データとして利用され、意図せず外部に漏洩するケースが懸念されます。また、生成されたコンテンツが既存の著作物を無断で利用している可能性もあり、企業が著作権侵害の当事者となるリスクも無視できません。このような新たなリスクに対応するためには、企業としての統一された方針を示す社内規定が不可欠です。

従業員が安心してAIを活用できる環境整備の重要性

社内規定は、単にリスクを制限するためだけのものではありません。むしろ、「ここまでなら安全に利用できる」という明確な基準を示すことで、従業員が萎縮することなく、積極的に生成AIを業務改善に活用することを後押しする役割を持ちます。ルールが整備されることで、従業員はリスクを恐れることなく、生産性向上に集中できます。結果として、企業全体の競争力を高めることにも繋がるのです。

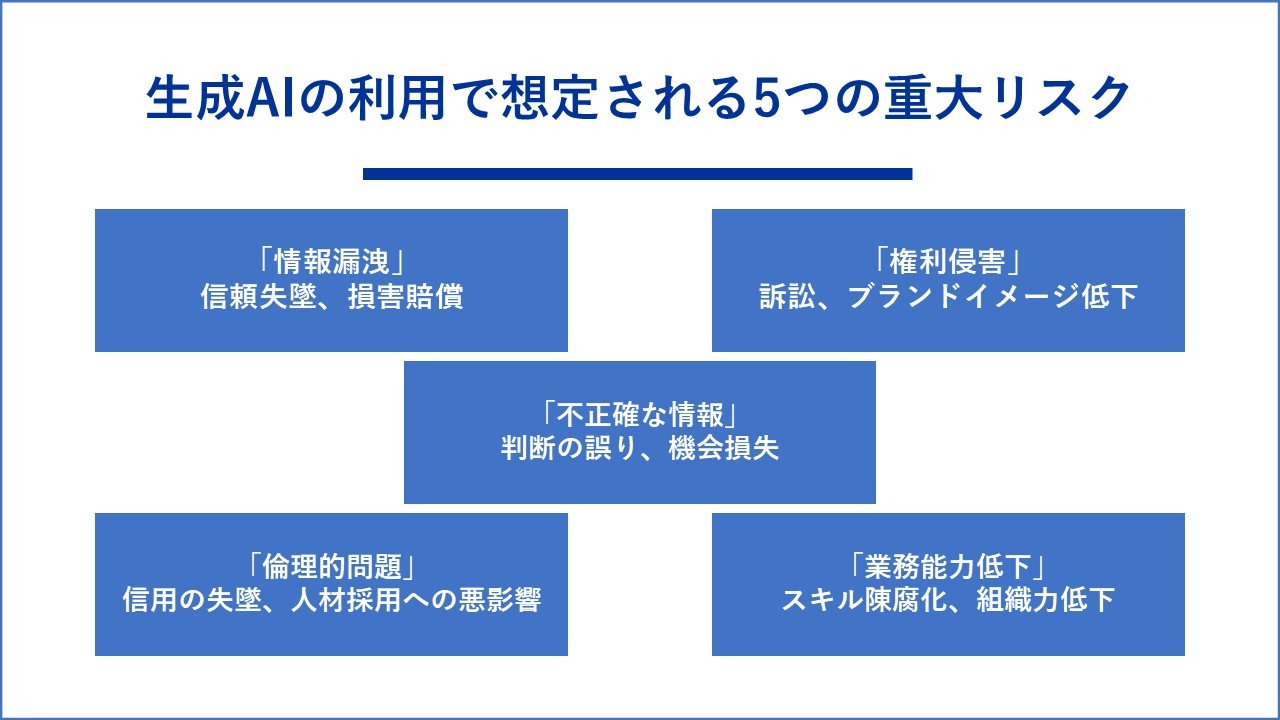

生成AIの利用で想定される5つの重大リスク

生成AIの社内規定を策定する上で、まず理解しておくべきは具体的なリスクです。

ここでは、特に重要と考えられる5つのリスクについて解説します。

これらのリスクを正しく認識することが、実効性のある規定作りの第一歩となります。

【リスク1】機密情報や個人情報の漏洩リスク

最も警戒すべきリスクの一つが、機密情報や個人情報の漏洩です。従業員が業務上の機密情報(例:未公開の財務データ、開発中の製品情報)や顧客の個人情報を生成AIに入力した場合、そのデータがAIの開発元サーバーに送信され、学習データとして利用される可能性があります。これにより、他のユーザーへの回答に自社の機密情報が含まれてしまうといった、深刻な情報漏洩に繋がる恐れがあります。

【リスク2】著作権や知的財産権の侵害リスク

生成AIは、インターネット上の膨大なデータを学習してコンテンツを生成します。そのため、生成された文章や画像が、既存の著作物と酷似してしまう、あるいは意図せず他社の商標を含んでしまう可能性があります。これを知らずに商用利用した場合、著作権や商標権の侵害として、損害賠償請求や差止請求を受けるリスクがあります。

【リスク3】AIが生成する不正確な情報の利用リスク

生成AIは、時に「ハルシネーション」と呼ばれる、もっともらしい嘘の情報を生成することがあります。生成された情報を事実確認(ファクトチェック)せずに、そのまま企画書や顧客への提出資料に利用してしまうと、誤った意思決定につながったり、企業の信用を損なったりする原因となります。情報の正確性を担保する最終的な責任は、AIではなく利用する人間にあることを認識しなければなりません。

【リスク4】倫理的な問題や差別助長のリスク

生成AIの学習データには、インターネット上に存在する偏った情報や差別的な表現が含まれている可能性があります。その結果、AIが特定の属性に対する偏見を助長するような、倫理的に不適切なコンテンツを生成することがあります。こうした生成物を企業の公式な発信などに利用した場合、社会的な批判を受け、企業イメージを大きく損なう可能性があります。

【リスク5】AIへの過度な依存による業務能力低下リスク

生成AIは思考の補助ツールとして非常に有用ですが、過度に依存すると、従業員自らが考えて文章を作成したり、課題解決策を練ったりする能力が低下する懸念があります。短期的な効率化を優先するあまり、長期的には組織全体の思考力や創造性が失われるリスクも考慮に入れるべきです。

社内規定に盛り込むべき必須の10項目

効果的な社内規定を作成するためには、網羅すべき項目を体系的に整理することが重要です。

ここでは、多くの企業で共通して必要となる10の必須項目を挙げ、それぞれで定めるべき内容を解説します。

これらの項目をベースに、自社の状況に合わせて内容を調整してください。

| 項目 | 定める内容のポイント | なぜ必要か |

| 目的と基本方針 | リスク管理と利活用の 両立を目指す姿勢を示す。 |

規定全体の方向性を定め、 従業員の理解を助けるため。 |

|

適用範囲 |

正社員、契約社員、業務委託など 対象者を網羅する。 |

抜け漏れなく、全ての関係者に ルールを遵守させるため。 |

| 利用許諾ツール | 会社が安全性を確認したツールのみに限定する (ホワイトリスト方式)。 |

セキュリティリスクの高い 野良ツールの利用を防ぐため。 |

| 入力禁止情報 | 個人情報、顧客情報、社外秘情報などを 具体的に列挙する。 |

最も重大な情報漏洩リスクを 直接的に防止するため。 |

| 生成物の扱い | 人によるファクトチェックを必須とし、 最終責任は利用者にあると明記する。 |

AIの誤情報を鵜呑みにする リスクを防ぐため。 |

| 権利の取り扱い |

著作権侵害の有無を |

法的な紛争に巻き込まれる |

| 倫理的配慮 |

差別助長や誹謗中傷目的での |

企業の社会的責任を果たし、 |

| 罰則 |

就業規則に基づく |

規定の実効性を高め、 |

| 相談・報告体制 |

担当部署(情シス、法務など)を |

問題発生時に迅速に対応し、 |

| 見直し |

技術や法制度の変更に対応するため、 |

設定したルールが |

【その1】規定の目的と基本方針を明確にする

まず、規定の冒頭で「何のためにこの規定を定めるのか」という目的を明確にします。例えば、「生成AIの利用に伴うリスクを管理し、従業員が安全かつ効果的にAIを活用することで、生産性向上を図ることを目的とする」といった内容です。これにより、規定全体の一貫性を保ち、従業員の理解を促進します。

【その2】対象となる従業員の範囲を定める

この規定が誰に適用されるのかを明記します。正社員だけでなく、契約社員、派遣社員、業務委託先の従業員など、自社の情報資産にアクセスする可能性のあるすべての人員を対象範囲に含めることが一般的です。

【その3】利用を許可する生成AIツールを指定する

会社として利用を認める生成AIサービスを具体的に指定します(ホワイトリスト方式)。例えば、「会社が契約する法人向けツールのみ利用を許可し、個人アカウントでの無料版AIツールの業務利用は禁止する」といった形です。これにより、セキュリティレベルが担保されていないツールの利用(シャドーIT)を防ぎます。

【その4】入力を禁止する情報を具体的に列挙する

情報漏洩リスクを回避するため、生成AIへの入力が固く禁じられる情報の種類を具体的にリストアップします。これには、個人情報、顧客情報、取引先情報、技術情報、財務情報、人事情報など、企業の機密情報全般が含まれます。

【その5】生成物の利用範囲と責任の所在を定義する

AIが生成したコンテンツ(生成物)を業務上どのように扱うべきかを定めます。例えば、「生成物はあくまで下書きや参考情報として扱い、社外に公開する場合は必ず人間の目による確認と修正を必須とする」といったルールを設定します。また、生成物の内容に関する最終的な責任は、AIではなく利用者自身が負うことを明確に規定します。

【その6】著作権や商標権の取り扱いを定める

生成物が第三者の著作権や商標権を侵害していないかを確認する義務を利用者に課します。特に、社外向けのコンテンツやデザインを作成する際には、類似の著作物がないかを確認するプロセスを義務付けることが重要です。

【その7】AI利用における倫理的配慮を盛り込む

差別や偏見を助長するような目的でのAI利用を明確に禁止します。また、生成された内容が他者の名誉を毀損したり、誹謗中傷にあたるものでないかを確認するよう明記します。

【その8】規定に違反した場合の罰則を規定する

規定の実効性を担保するため、違反した場合の措置について言及します。通常は、就業規則の懲戒規定に基づき処分が下される旨を記載します。これにより、従業員に規定遵守の重要性を認識させます。

【その9】社内での相談窓口や報告体制を設置する

利用方法に迷った場合や、規定違反の恐れがある事態を発見した場合の相談・報告窓口を定めます。法令遵守の観点から助言を行う法務部門に加え、AIツールの導入・運用を所管する情報システム部門が関与できる体制を整えることが重要です。これにより、問題の早期発見と対応が可能になります。

【その10】定期的な見直しと更新について言及する

生成AIの技術や関連法規は急速に変化するため、規定も定期的に見直す必要があります。「半年に1回」や「重大な技術的・法的な変更があった場合」など、見直しのタイミングをあらかじめ規定に盛り込んでおくことが望ましいです。

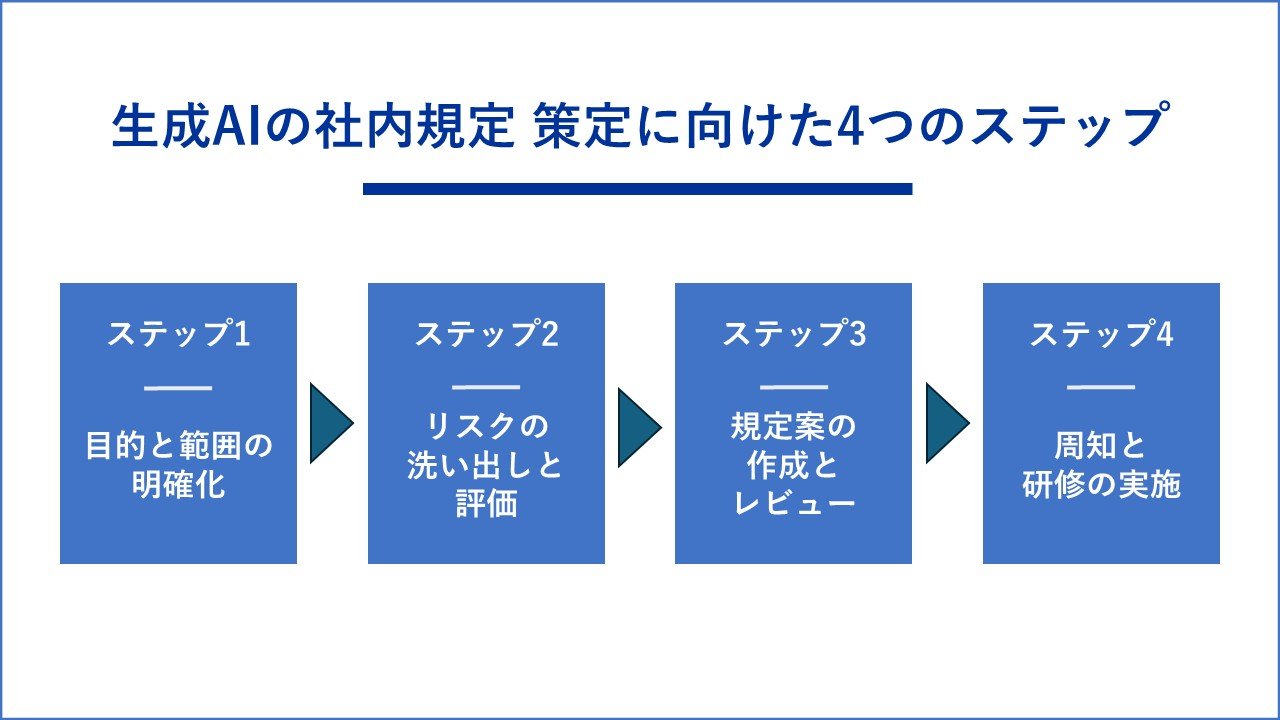

生成AIの社内規定を策定する4つのステップ

実用的で、かつ社内に浸透する規定を作成するためには、計画的なアプローチが重要です。

ここでは、規定策定を4つの具体的なステップに分けて解説します。

このプロセスに沿って進めることで、抜け漏れなく、関係者の合意を得ながら策定を進めることができます。

【ステップ1】利用目的と範囲の明確化

最初に、「自社は何のために生成AIを活用するのか」という目的を定義します。例えば、「定型的な文章作成業務の効率化」「マーケティングコンテンツのアイデア創出支援」など、具体的な活用シーンを想定します。次に、どの部署で、どのような業務範囲で利用を許可するのかを決定します。全部署一律のルールとするのか、特定の部署からスモールスタートするのかを検討します。

【ステップ2】リスクの洗い出しと評価

ステップ1で定めた利用目的と範囲に基づき、想定されるリスクを具体的に洗い出します。例えば、顧客対応部門で利用する場合は「個人情報の入力リスク」が、開発部門で利用する場合は「ソースコードの漏洩リスク」が高まります。洗い出したリスクを、「発生可能性」と「発生した場合の影響度」の2軸で評価し、優先的に対策すべきリスクを特定します。

【ステップ3】規定案の作成と関連部署レビュー

洗い出したリスクへの対策を盛り込みながら、前章の「必須10項目」を骨子として規定の草案を作成します。草案が完成したら、法務、情報システム、そして実際にAIを利用する事業部門など、関連部署にレビューを依頼します。法務部門には法的な妥当性を、情報システム部門には技術的な実現性を、事業部門には業務実態との整合性を確認してもらい、多角的な視点で内容をブラッシュアップします。

【ステップ4】全従業員への周知と研修の実施

最終化された規定は、ただ社内ポータルに掲載するだけでは不十分です。全社説明会を開催したり、eラーニング形式の研修を実施したりして、従業員一人ひとりに規定の内容と、その背景にあるリスクを深く理解してもらう機会を設けることが不可欠です。なぜこのルールが必要なのかを丁寧に説明することで、従業員の納得感を高め、規定の遵守に繋げます。

【雛形】すぐに使える生成AI利用ガイドラインのテンプレート

ゼロから規定を作成するのは大変な作業です。ここでは、基本的な項目を網羅したテンプレート(雛形)を紹介します。

これをベースに、自社の業務内容や文化に合わせて適宜カスタマイズしてご活用ください。

ガイドラインのサンプルを紹介

※以下サンプルは構成の一例を示したものです。

具体的な制度設計や法的判断については、各社の状況に応じて専門部署・専門家へご相談ください。

| 生成AI利用ガイドライン 第1条(目的) 本ガイドラインは、当社における生成AIの業務利用に関する基本ルールを定め、 情報漏洩等のリスクを防止し、安全かつ効果的な活用を通じて生産性の向上に資することを目的とする。 第2条(適用範囲) 本ガイドラインは、当社の全従業員(正社員、契約社員、派遣社員、その他当社の業務に従事する者)に適用する。 第3条(利用許諾ツール) 業務で利用可能な生成AIは、会社が別途指定するツール(例:〇〇社提供の法人向けプラン)に限る。 個人で契約する生成AIツールの業務利用は原則として禁止する。 第4条(入力禁止情報) 以下の情報を含む内容を、生成AIに入力してはならない。 1. 個人情報保護法に定める個人情報 2. 顧客、取引先に関する情報、および、これらの者との契約により秘密保持義務を負う情報 3. 当社の営業秘密、技術情報、その他一切の社外秘情報 4. その他、未公開の重要情報 第5条(生成物の取り扱い) 1. 生成物は、その内容の正確性、妥当性、および第三者の権利を侵害しないことを、 利用者自身の責任で確認しなければならない。 2. 生成物を社外に公開、または顧客に提供する場合は、必ず所属長による承認を得ること。 3. 生成AIの出力を、検証なしに当社の公式な見解や成果物として使用してはならない。 第6条(その他) 本ガイドラインに違反した場合は、就業規則に基づき懲戒処分の対象となる場合がある。 本ガイドラインの解釈に疑義が生じた場合は、速やかに〇〇部(相談窓口)に問い合わせること。 附則 本ガイドラインは、YYYY年MM月DD日より施行する。 |

自社向けにカスタマイズする際のポイント

上記のテンプレートはあくまで基本的な骨格です。カスタマイズする際には、特に以下の点を考慮してください。

①業種・業態の特性

金融機関や医療機関など、特に機密性の高い情報を扱う業界では、入力禁止情報をより厳格に定義する必要があります。

②利用する部署の業務内容

例えば、マーケティング部門にはコンテンツ生成での活用を推奨し、

法務部門では契約書レビューでの利用を禁止するなど、

部署ごとに利用可能な用途を細かく設定することも有効です。

③企業の文化

ルールで厳しく縛るよりも、従業員の判断を尊重する文化の企業であれば、禁止事項を最小限にし、

判断の拠り所となる原則を示す形が馴染むかもしれません。

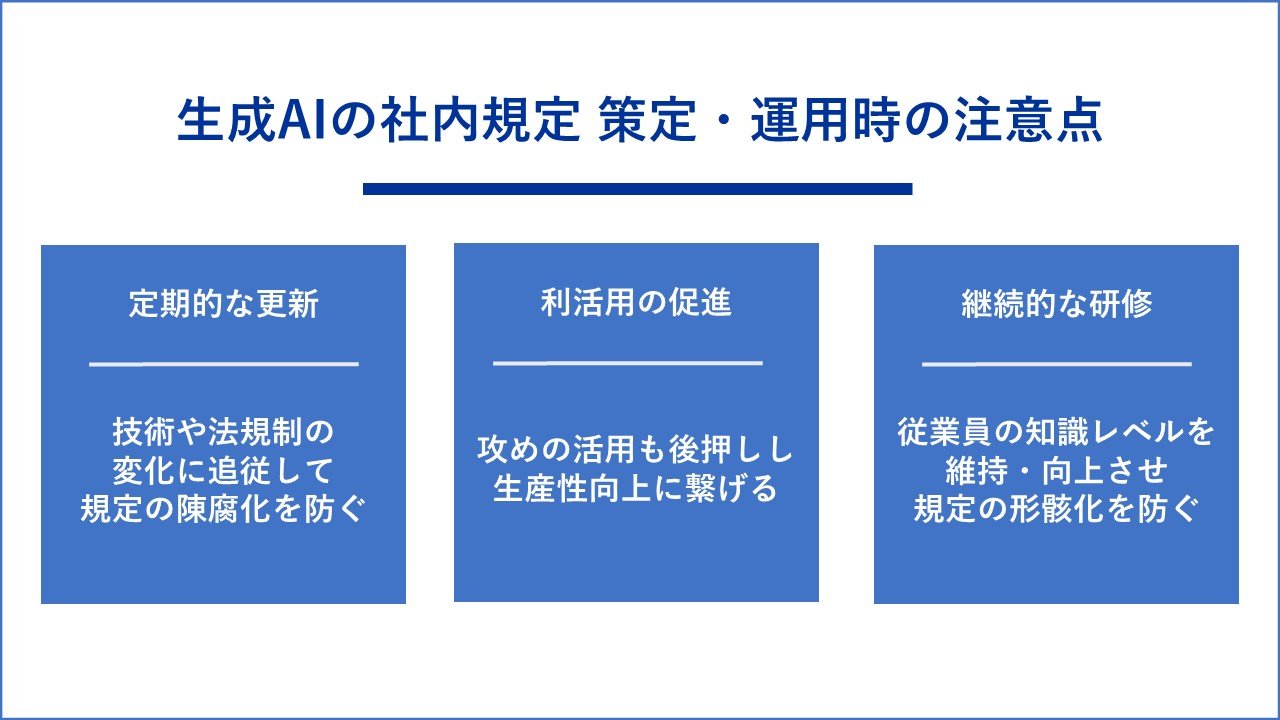

生成AIの社内規定を策定・運用する際の3つの注意点

規定は作って終わりではありません。

技術の進化や社会の変化に対応し、形骸化させないための運用が極めて重要です。

ここでは、規定を策定し、運用していく上で特に注意すべき3つのポイントを解説します。

【注意点1】技術の進歩に合わせて内容を定期的に更新する

生成AIの技術は日進月歩で進化しており、新しいサービスや機能が次々と登場します。また、AIに関する法律や規制も、今後整備が進むと予想されます。そのため、策定した規定がすぐに時代遅れになる可能性があります。最低でも半年に一度は内容を見直し、最新の状況に合わせてアップデートするプロセスを組み込んでおくことが重要です。

【注意点2】禁止事項だけでなく利活用の促進も検討する

規定を作成する際、リスク管理の側面から「禁止」事項ばかりに目が行きがちです。しかし、過度な制限は、生産性向上の機会を奪うことにもなりかねません。「〇〇は禁止」と書くだけでなく、「△△の目的で、□□という手順を踏めば利用できる」といった、安全な利活用を促進する側面も盛り込むことで、規定がポジティブに受け入れられやすくなります。

【注意点3】従業員への研修を徹底し理解を深める

規定を策定しても、その存在や内容が従業員に知られていなければ意味がありません。全社的な研修の実施はもちろん、新入社員研修のカリキュラムに組み込んだり、定期的に社内報で注意喚起を行ったりするなど、継続的な教育と啓発活動が不可欠です。なぜそのルールが必要なのかという背景まで含めて伝えることで、従業員の自律的なリスク管理意識を高めることができます。

【参考】国内企業の生成AIガイドライン策定事例

他社がどのようなガイドラインを策定しているかを知ることは、自社の規定を作成する上で非常に参考になります。ここでは、国内の主要企業におけるガイドラインの運用事例をいくつか紹介します。各社の考え方や重点を置いているポイントを比較し、自社の参考にしてください。

| 企業名 | ガイドラインの主な特徴 | 参考になるポイント |

| パナソニックコネクト | 具体的な活用シナリオと 禁止事項を併記。 |

従業員が利用シーンを イメージしやすい。 |

| 富士通 | 大規模組織向けに、情報漏洩対策と ファクトチェック義務を徹底。 |

統制とリスク教育を重視した |

【事例1】パナソニックコネクト株式会社の事例

同社では、セキュリティとコンプライアンスを重視しつつ、従業員の生産性向上を目的としたガイドラインを策定しています。特に、個人情報や機密情報の入力を厳しく禁止する一方で、社内文書の要約や翻訳、プログラムコードの生成など、具体的な活用シナリオを提示している点が特徴です。従業員が判断に迷わないよう、具体的な「やってはいけないこと」と「推奨される使い方」を明確に示しています。

【参考】「ConnectAI」が変える働き方。パナソニック コネクトが描く、AIと共創する未来 - パナソニック コネクト

【事例2】富士通株式会社の事例

同社は、従業員向けに策定したガイドラインを2024年より一般公開しています。情報漏洩対策の観点から、入力した情報をAIの学習に利用させない「オプトアウト」手続きに関する注意事項を説明している点が特徴的です。また、生成物の正確性について、利用者が必ずファクトチェックを行うことを義務付けており、AIの出力を鵜呑みにすることのリスクを強く注意喚起しています。大規模組織における統制と教育を重視したガイドラインと言えるでしょう。

【参考】'Fujitsu Generative AI Guidelines' opened to the public

まとめ

生成AIの社内規定策定は、単なるリスク管理のための作業ではありません。それは、新たなテクノロジーと共存し、その恩恵を最大限に引き出すための経営戦略そのものです。

本記事で解説したリスク、盛り込むべき項目、策定ステップ、そして他社事例を参考に、自社の実態に即した実効性のある規定を作成してください。

明確なルールのもとで、従業員一人ひとりが安心して生成AIを活用できる環境を整えること。それが、これからの時代に企業が持続的に成長していくための重要な鍵となるでしょう。

AGSの「AI-Zanmai」では、企業・団体向けにカスタマイズされたセキュアなAI環境を皆様へご提供します。ユーザーの入力データがAI学習に利用されないため、機密性の高い規定類も安心して管理いただけます。1カ月の無料トライアルも可能ですので、気になる方はぜひ、以下のリンクから詳細をご確認ください。